Після запуску чат-бота ChatGPT від OpenAI у листопаді минулого року інструменти штучного інтелекту почали кардинально змінювати спосіб життя та роботи людей. Хоча спільнота штучного інтелекту залишається переважно «чоловічою», останніми роками деякі дослідники та компанії намагаються зробити її більш привітною для жінок та інших малопредставлених груп.

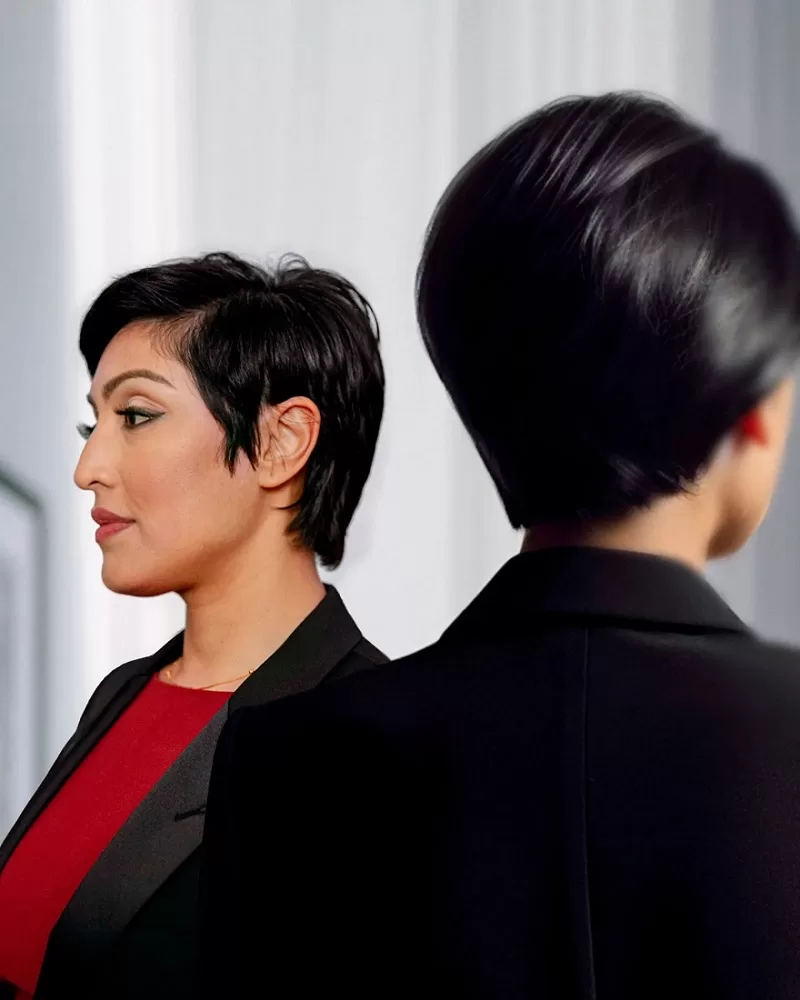

Американський журнал Wired створив артпроєкт та розповів про рух, очолюваний переважно жінками, що вивчає етичні та суспільні наслідки впровадження технології.

«Я хотіла використати генеративний штучний інтелект, щоб зафіксувати потенціал і почуття неспокою, коли ми досліджуємо наш зв’язок із цією новою технологією. Це було схоже на розмову: я подаю зображення та ідеї ШІ, а ШІ пропонує свої власні», — каже художниця Сем Кеннон, яка разом із чотирма фотографами працювала над покращенням портретів за допомогою фону, створеного штучним інтелектом.

“I wanted to use generative AI to capture the potential and unease felt as we explore our relationship with this new technology,” says artist @samcannon, who worked with four photographers to enhance portraits with AI-crafted backgrounds to create the images in this thread. 🧵 pic.twitter.com/OH0BMWuStm

— WIRED (@WIRED) July 22, 2023

Колишня очільниця підрозділу Twitter, що займався етикою ШІ, поки компанію не придбав Ілон Маск і не звільнив її команду, Румман Чоудхурі є співзасновницею некомерційної організації Humane Intelligence, яка використовує краудсорсинг для виявлення вразливостей у системах штучного інтелекту. Перший захід, запланований на це літо за підтримки Білого дому, буде тестувати генеративні системи штучного інтелекту від компаній, зокрема Google і OpenAI.

Сара Берд працює в Microsoft, її робота полягає в контролі за генеративним штучним інтелектом, який компанія додає до своїх офісних програм та інших продуктів. Спостерігаючи за тим, як генератори тексту, подібні до того, що стоять за чат-ботом Bing, стають ефективнішими та кориснішими, вона також бачила, як вони стають кращими у створенні упередженого вмісту та шкідливого коду. Її команда працює над тим, щоб стримати цей «темний бік» технології. Берд каже, що штучний інтелект може змінити життя багатьох людей на краще, але «ніщо з цього неможливе, якщо люди переймаються через технологію, що створює стереотипні результати».

Професорка Школи комп’ютерних наук та інженерії Вашингтонського університету Єджін Чой розробляє модель із відкритим вихідним кодом під назвою Delphi, призначену для розуміння правильного та неправильного. Її цікавить, як люди сприймають заяви Delphi з морального погляду. Чой хоче мати такі ж потужні системи, як OpenAI і Google, що не потребують великих ресурсів. «Поточна увага до ваги є дуже нездоровою з різних причин. Це повна концентрація влади, просто занадто дорого, і навряд чи це єдиний шлях», — вважає вона.

У 2017 році Маргарет Мітчелл заснувала дослідницьку групу Google з питань етики штучного інтелекту. Через чотири роки її звільнили після суперечки з керівниками щодо статті, співавтором якої вона була. Було попередження, що великі мовні моделі — технологія ChatGPT — можуть зміцнювати стереотипи та спричиняти інші проблеми. Зараз Мітчелл є керівником відділу етики в Hugging Face — стартапі, що розробляє програмне забезпечення ШІ з відкритим кодом для програмістів. Вона працює над тим, щоб розробки компанії не приносили неприємних сюрпризів, і заохочує спеціалістів ставити людей перед алгоритмами. На її думку, генеративні моделі можуть бути корисними, але вони також можуть підривати відчуття правди у людей.

Коли Ініолува Дебора Раджі починала роботу в галузі штучного інтелекту, вона працювала над проєктом, який виявив упередженість в алгоритмах аналізу обличчя: вони були найменш точними для жінок із темною шкірою. Результати змусили Amazon, IBM і Microsoft припинити продажі технології розпізнавання обличчя. Зараз Раджі працює з Mozilla Foundation над інструментами з відкритим кодом, які допомагають людям перевіряти системи штучного інтелекту на недоліки, такі як упередженість і неточність, включаючи великі мовні моделі. Раджі каже, що ці інструменти можуть допомогти спільнотам, які постраждали від ШІ, оскаржити претензії потужних технологічних компаній. «Люди активно заперечують факт шкоди, тому збір доказів є невіддільною частиною будь-якого прогресу в цій галузі», — каже вона.

Раніше Даніела Амодей працювала над політикою штучного інтелекту в OpenAI, допомагаючи закласти основу для ChatGPT. Але у 2021 році вона та кілька інших співробітників залишили компанію, щоб заснувати Anthropic, суспільно корисну корпорацію, яка розробляє власний підхід до безпеки ШІ. Чат-бот стартапу, Клод, має «конституцію», яка керує його поведінкою, засновану на принципах, взятих, зокрема, із Загальної декларації прав людини ООН. Даніела Амодей каже, що подібні ідеї зменшать прояви неправильної поведінки сьогодні і, можливо, допоможуть стримати потужніші системи ШІ майбутнього: «Дуже важливо думати про потенційний вплив цієї технології в довгостроковій перспективі».

Головна операційна директорка дослідницького підрозділу Google DeepMind, який займає центральне місце в проєктах генеративного штучного інтелекту Google Ліла Ібрагім, яка вважає моральним покликанням те, що вона керує однією з найпотужніших у світі лабораторій ШІ. Ібрагім приєдналася до DeepMind п’ять років тому, після майже двох десятиліть роботи в Intel, в надії допомогти ШІ розвиватися на благо суспільства. Одна з її ролей — очолювати внутрішню наглядову раду, яка обговорює, як збільшити переваги проєктів DeepMind і уникнути негативних результатів. «Я подумала, що якщо я зможу застосувати частину свого досвіду та знань, щоб допомогти впровадити цю технологію у світі більш відповідально, тоді це варте того, щоб бути тут», — говорить вона.

- Раніше науковці з Кембриджського університету оприлюднили результати дослідження щодо впливу кінематографу на гендерну нерівність. Виявилося, що фільми про індустрію штучного інтелекту, на кшталт «Залізної людини» чи Ex Machina, зображуючи дослідниками штучного інтелекту майже виключно чоловіків, допомагають закріпити системну гендерну нерівність у галузі технологій.

- Журналісти BBC з’ясували, що технологію штучного інтелекту використовують для створення дитячого порно у промислових масштабах: створення та продажу контенту з реалістичним зображенням сексуального насильства над дітьми, зокрема зґвалтування немовлят і дітей раннього віку.